谷歌近期推出的Gemini 3 Flash模型引發了人工智能領域的廣泛關注。這款輕量級模型不僅在成本和速度上表現優異,更在復雜推理和超長上下文處理任務中超越了自家參數規模更大的Pro版本,徹底顛覆了業界對模型性能與參數規模線性關系的傳統認知。

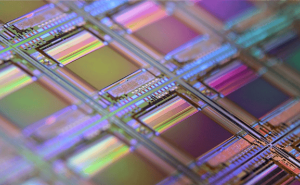

在OpenAI的MRCR基準測試中,Gemini 3 Flash以百萬級上下文長度實現了90%的準確率,而大多數頂尖模型甚至無法突破256k的上下文限制。這一突破性表現源于谷歌在模型架構上的創新,而非單純依賴參數堆砌。據AI研究員@bycloudai分析,Gemini 3 Flash可能采用了某種高效注意力機制,在降低算力成本的同時保持了強大的知識推理能力。

傳統評估長上下文能力的"大海撈針"(NIAH)測試已逐漸失效,因為早期模型在該測試中均能達到近100%的準確率。然而,NIAH僅測試檢索能力,無法衡量模型對信息間復雜依賴關系的理解。為此,獨立研究者開發的Context Arena平臺引入了更具挑戰性的MRCR測試,通過植入多個高度相似的"針"并要求模型完成精準指令,有效區分了不同模型的長程記憶穩定性。

Gemini 3 Flash在MRCR測試中的統治力證明其未因追求速度而犧牲注意力精度。該模型采用混合架構設計,底層可能使用Infini-attention處理超長歷史信息,頂層結合標準注意力進行邏輯推理,并通過混合專家模型(MoE)降低計算成本。這種三位一體的優化策略使其在數據、計算和記憶層面均實現突破。

在數據層面,Gemini 3 Flash通過Gemini 3 Pro進行大規模思維鏈蒸餾,將高階推理能力壓縮進輕量級模型;計算層面引入"思考"機制,允許模型動態分配資源處理難題;記憶層面部署Infini-attention和新型記憶模塊,將指數級注意力成本降維,實現百萬級上下文的高精度檢索。這些創新使其在Pokémon游戲通關和SWE-bench代碼修復等任務中表現超越Pro版本。

谷歌DeepMind最新提出的Titans架構為Gemini 3 Flash的性能突破提供了理論支撐。該架構結合Transformer與神經記憶模塊,包含核心短期記憶、長期記憶和持久記憶三部分。其獨特之處在于通過"驚奇度"指標動態更新長期記憶網絡權重,使模型在推理階段持續學習當前上下文,而非被動存儲信息。這種設計使模型能優先記憶意外重要信息,同時通過自適應權重衰減機制管理記憶容量。

與Titans架構配套的MIRAS理論框架則提供了序列建模的統一視角。該框架將不同架構視為解決同一問題的變體——高效結合新舊記憶,同時保留核心概念。通過定義內存架構、注意力偏見、保留門和內存算法四個關鍵設計選擇,MIRAS揭示了在線優化、聯想記憶與架構設計之間的深層聯系,為新一代序列模型開發指明了方向。

盡管谷歌未公開Gemini 3 Pro與Flash的具體參數規模,但行業估算顯示兩者參數數量級相差近5至10倍。這種"輕量級反超"現象標志著AI發展進入新階段,模型性能不再單純依賴參數堆砌,而是通過更高效的信息路由與記憶機制實現質的飛躍。Gemini 3 Flash的成功不僅降低了AI應用門檻,更推動了智能代理技術的爆發式增長,為企業級知識庫處理和代碼庫重構等場景提供了強大工具。