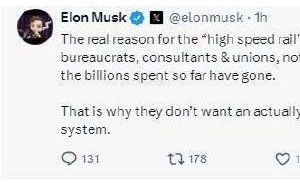

馬斯克在社交平臺X上對阿里通義千問團隊發布的Qwen3.5小模型系列給予高度評價,稱其“令人印象深刻的智能密度”。這批覆蓋0.8B、2B、4B和9B四個參數規格的模型甫一發布,便在海外科技圈引發廣泛關注,開發者紛紛探討其技術突破與應用潛力。

Qwen3.5系列模型采用“門控增量網絡與稀疏混合專家”結合的混合注意力架構,注意力層按3:1比例配置Gated DeltaNet與Gated Attention層。這一設計使模型在前向傳播時僅激活必要網絡部分,顯著降低算力消耗與推理延遲,同時支持長達26萬Token的上下文窗口,并引入“思考”與“非思考”雙模式,兼顧深度邏輯推理與快速響應需求。

多模態能力是該系列的核心亮點。通過“早期融合”訓練機制,文本、圖像、視頻數據在底層統一處理,而非簡單疊加視覺編碼器。這種架構使小參數模型在視覺問答、OCR文檔理解等任務中表現優異:0.8B模型在視覺任務MathVista上得分62.2,OCRBench達74.5;2B模型的OCRBench進一步提升至84.5;9B模型更以MMLU-Pro得分82.5超越參數量為其三倍的上一代Qwen3-30B,并在視覺任務上領先GPT-5-Nano與Gemini 2.5 Flash Lite。

硬件適配性方面,0.8B與2B模型采用24層結構,隱藏維度分別為1024和2048,專為物聯網設備與主流手機設計,可直接原生運行;4B模型為32層結構,隱藏維度2560,適配消費級移動硬件;9B模型隱藏維度擴展至4096,FFN維度達12288,可在Mac上流暢運行。開發者已演示在iPhone 17 Pro上通過MLX框架本地運行Qwen3.5-2B 6-bit版本,實時完成視覺理解與問答任務。

開源社區對Qwen3.5系列反應熱烈。知名推理工具Ollama迅速宣布支持全系模型,提供原生工具調用、思維鏈推理與多模態功能,用戶可通過一行命令部署運行。海外開發者評價稱,9B模型性能與120B參數量的ChatGPT開源模型相當,但體積僅為其十三分之一,且完全免費,可運行于筆記本電腦乃至手機端。另有開發者指出,當前僅需3萬美元硬件即可實現一年前需20萬美元GPU配置的推理能力,每十億參數的智能密度成為關鍵指標。

阿里千問技術負責人曾解釋開源初衷:小模型起源于降低學生研究成本的實驗需求,7B規模已讓許多碩博生無力承擔實驗費用,而1.8B模型的開源可幫助更多人完成學業。這一理念推動Qwen系列持續開源,客觀上降低了AI技術使用門檻。普通用戶現可通過PocketPal AI應用本地運行Qwen3.5系列,無需API調用,模型推理全程在設備端完成,并支持中文界面切換。

硬件協同是Qwen3.5系列的核心應用場景。阿里已將模型嵌入AI眼鏡等可穿戴設備,實現毫秒級端側視覺解析,解決云端大模型在物理場景中的延遲瓶頸。例如,用戶通過AI眼鏡詢問前方障礙物時,端側需實時完成場景解析與反饋,延遲超過三秒將失去實用價值。類似技術還可應用于iPhone“視覺智能”功能,通過攝像頭實時解析餐廳或商品信息,并直接喚起購買流程,全程無需云端交互。

工業領域同樣存在大量本地推理需求。IoT設備、工廠傳感器與醫療監測終端等場景對數據隱私敏感,端側小模型可實時處理第一視角多模態數據,成為關鍵基礎設施。隨著蘋果開發帶攝像頭的AirPods與智能眼鏡,這些設備將化身用戶的“第二雙眼睛和耳朵”,進一步推動端云協同架構的普及——復雜問題交由云端大模型處理,日常任務則由端側小模型獨立完成。