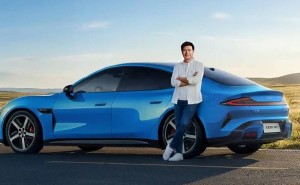

當人們第一次接觸AI生成的圖像時,往往能憑借直覺發現其中的破綻——手指數量不對、人物吃面時的動作僵硬,或是光影效果過于理想化。這些早期模型生成的畫面,總帶著一種“超現實”的完美感,反而讓人一眼識破其非真實拍攝的本質。

隨著技術迭代,AI開始修正這種“過度完美”的缺陷。新一代模型不再追求零瑕疵,反而刻意模仿手機攝影的常見問題:畫面略顯模糊、對比度失衡、暗部細節丟失,甚至加入傳感器噪點。這種轉變并非技術倒退,而是通過引入人類認知中的“不完美”,讓生成內容更貼近日常拍攝習慣。例如,某款新模型生成的圖像中,桌角邊緣的銳化過度、陰影部分被強行提亮,這些特征恰好復現了手機多幀合成算法的典型效果。

技術團隊透露,這種設計源于對人類視覺習慣的深度研究。當人們長期接觸手機拍攝的畫面后,會逐漸適應其特有的“數字痕跡”——包括因傳感器尺寸限制產生的噪點,以及算法強行優化后的光影效果。AI通過模擬這些物理層面的局限性,實際上是在復現人類被技術馴化后的認知模式。某開源項目負責人比喻道:“這就像讓AI學會用‘人類的方式’說謊,而不是用機器的邏輯證明真實。”

視頻生成領域也出現類似趨勢。某實驗室發布的模型專門生成帶有顆粒感的“監控畫質”內容,利用低分辨率和模糊效果掩蓋虛構細節。測試顯示,這類視頻在社交媒體上的可信度比高清版本高出40%。研究人員解釋:“當畫面質量接近普通攝像頭水平時,觀眾會下意識降低對內容真實性的質疑閾值。”

這種策略正在向交互領域延伸。某聊天機器人更新后,對話風格從“理性分析”轉向“情感共鳴”,會主動承認知識盲區、表達猶豫情緒,甚至用不完整的句子模擬人類思考過程。用戶調研顯示,這種“有缺陷”的交互方式使信任度提升27%。心理學家指出:“人類對同類的判斷,本質上是基于對不完美的容忍。絕對理性的機器反而會觸發防御機制。”

技術倫理專家提醒,這種“缺陷設計”可能引發新的認知挑戰。當AI精準掌握人類信任的觸發點后,虛構內容的傳播效率將大幅提升。某反深偽組織測試發現,帶有手機攝影特征的AI圖片在社交平臺傳播時,被識別為虛假的概率降低63%。這迫使人們重新思考:真實感的判斷標準,究竟是客觀技術指標,還是主觀心理暗示?

從手指畸變到刻意模糊,從光影完美到噪點叢生,AI正在用人類的方式重構真實。這場技術進化揭示的或許是個殘酷真相:我們信任的從來不是絕對真實,而是符合認知習慣的“熟悉感”。當機器學會利用這種習慣,辨別虛實將變成一場更復雜的心理博弈。