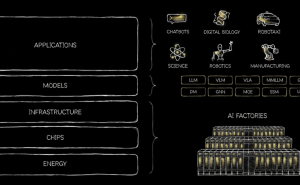

近年來,人工智能領域的發展引發了廣泛關注,尤其是大模型技術的突破,讓人們對其未來充滿期待。然而,隨著ChatGPT、DeepSeek、Gemini 3、GPT-5.2等頂級模型相繼問世,一個關鍵問題逐漸浮現:支撐這些模型進步的Scaling Law是否即將觸及天花板?這一疑問正在行業內引發激烈討論。

多位知名專家對Scaling Law的未來表達了不同看法。Ilya Sutskever指出,單純依靠增加預訓練算力的方式正在進入平臺期,智能提升需要轉向新的研究范式。Yann LeCun則直言,當前大語言模型無論怎樣擴展規模,都無法真正實現通用人工智能(AGI)。Sam Altman也承認,僅靠增加GPU數量已無法獲得同比例的智能提升。這些觀點反映了行業對算力增長與智能提升之間關系的深刻反思。

尤洋進一步分析了大模型成功的關鍵因素。他強調,Next-Token Prediction作為一種損失函數設計,通過最小化人為干預,為模型提供了近乎無限的訓練數據。同時,Transformer架構的勝出并非因為它更接近人腦,而是因為其高度并行、計算密集的特性與GPU的計算模式高度契合。這些因素共同作用,使得大模型能夠在過去十年中持續放大算力投入,并將其轉化為可感知的智能提升。

然而,尤洋也指出,當前大模型發展正面臨真正的瓶頸。他區分了效率提升和智能上限提升兩個概念:前者關注如何用更少資源達到相同效果,后者則關注在相同計算總量下訓練出能力更強的模型。他認為,當前的問題不在于算力不足,而在于現有范式無法充分利用持續增長的算力。換句話說,模型、損失函數和優化算法對算力的"消化能力"正在下降。

針對未來發展方向,尤洋提出了一系列建議。他認為,不應局限于節省算力,而應探索如何更有效地消耗更多算力。具體方向包括:研究更高數值精度的計算能力,探索更高階的優化器,設計更具擴展性的模型架構或損失函數,以及進行更充分的訓練和超參數搜索。他特別強調,推理優化、低精度訓練等技術雖然對模型落地至關重要,但與提升智能上限屬于不同的技術路徑。

隨著AI技術的不斷發展,如何將算力真正轉化為智能已成為行業面臨的核心挑戰。尤洋的觀點為從業者提供了新的思考角度:當算力仍在增長但智能提升放緩時,需要重新審視哪些因素才是決定智能上限的關鍵。這一討論不僅關乎技術發展方向,也將影響整個AI領域的未來格局。